Chronologie de l'IA

Test de Turing

Alan Turing propose le "Test de Turing" dans son article "Computing Machinery and Intelligence", établissant un critère pour déterminer si une machine peut penser.

Ce test pose la question fondamentale : "Les machines peuvent-elles penser ?"

Conférence de Dartmouth

John McCarthy organise la conférence de Dartmouth où le terme "intelligence artificielle" est officiellement adopté.

Cette conférence est considérée comme l'acte de naissance de l'IA en tant que domaine de recherche.

ELIZA

Joseph Weizenbaum crée ELIZA, le premier programme de traitement du langage naturel, qui simulait un psychothérapeute rogérien.

ELIZA démontre la possibilité d'une interaction homme-machine convaincante.

Deep Blue bat Kasparov

L'ordinateur Deep Blue d'IBM bat le champion du monde d'échecs Garry Kasparov, marquant un tournant dans les capacités de calcul.

Cet événement démontre que les machines peuvent surpasser les humains dans des tâches cognitives complexes.

IBM Watson

IBM Watson remporte le jeu télévisé Jeopardy! face à d'anciens champions, démontrant des capacités avancées de traitement du langage naturel.

Watson utilise l'apprentissage automatique et l'analyse de données pour comprendre et répondre à des questions complexes.

AlexNet

AlexNet, un réseau de neurones convolutifs, remporte le concours ImageNet avec une marge significative, déclenchant la révolution du deep learning.

Cette avancée démontre la puissance des réseaux de neurones profonds pour la vision par ordinateur.

AlphaGo

AlphaGo de DeepMind bat Lee Sedol, champion mondial de Go, un jeu considéré comme beaucoup plus complexe que les échecs pour les IA.

AlphaGo utilise des réseaux de neurones profonds et l'apprentissage par renforcement pour maîtriser ce jeu complexe.

IA Générative

L'émergence des modèles d'IA générative comme GPT, DALL-E et Stable Diffusion révolutionne la création de contenu textuel, visuel et audio.

Ces modèles transforment la façon dont nous interagissons avec la technologie et créons du contenu.

Les Origines de l'IA

Mythes et Automates

L'idée de créatures artificielles intelligentes remonte à l'Antiquité, avec des mythes comme celui de Pygmalion et ses statues qui prennent vie, ou les automates d'Héphaïstos dans la mythologie grecque.

Penseurs du 17ème siècle

Des philosophes comme René Descartes et Thomas Hobbes ont spéculé sur la possibilité de mécaniser la pensée. Leibniz a imaginé une "characteristica universalis" pour représenter toutes les connaissances de manière formelle.

Les Premiers Ordinateurs

Avec l'invention des premiers ordinateurs dans les années 1940, des pionniers comme Alan Turing ont commencé à explorer sérieusement la possibilité de machines intelligentes, posant les bases théoriques de l'IA.

Évolution des Approches

IA Symbolique (1950s-1980s)

Approche basée sur la logique et la manipulation de symboles. Les systèmes experts, qui capturent les connaissances humaines sous forme de règles, dominent cette période.

Les "Hivers" de l'IA

Périodes de réductions importantes du financement et de l'intérêt pour la recherche en IA, principalement dues à des attentes irréalistes et à des limitations techniques.

Montée de l'Apprentissage Machine

À partir des années 1990, l'approche statistique et l'apprentissage automatique gagnent en popularité, avec des algorithmes comme les réseaux de neurones et les machines à vecteurs de support.

L'IA Aujourd'hui

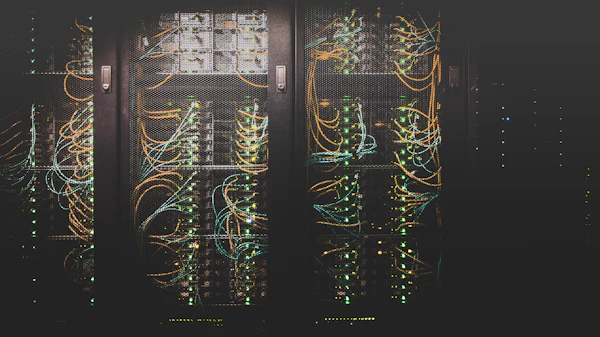

Deep Learning

Les réseaux de neurones profonds dominent aujourd'hui, avec des applications dans la vision par ordinateur, le traitement du langage naturel, la reconnaissance vocale et bien plus encore.

IA Générative

Des modèles comme GPT, DALL-E et Midjourney permettent de générer du texte, des images, de la musique et même du code de manière créative et convaincante.

IA dans la Vie Quotidienne

Recommandations personnalisées, assistants vocaux, véhicules autonomes, diagnostic médical assisté - l'IA fait désormais partie intégrante de notre quotidien.

L'Avenir de l'IA

Vers une IA Générale

La quête d'une intelligence artificielle générale (AGI) - une IA capable d'apprendre et d'accomplir n'importe quelle tâche intellectuelle qu'un humain peut faire - représente le prochain grand défi.

Éthique et Régulation

Alors que l'IA devient plus puissante, les questions d'éthique, de biais, de transparence et de régulation deviennent de plus en plus cruciales pour son développement responsable.

Collaboration Humain-IA

L'avenir pourrait voir une collaboration symbiotique entre humains et IA, où chaque partie complète les forces de l'autre pour résoudre des problèmes complexes.